فهرست مطالب

- 1. مقدمه

- 2. نقشه راه پژوهشی

- 3. جزئیات فنی

- 4. نتایج تجربی

- 5. تحلیل اصیل

- 6. کاربردها و جهتهای آینده

- 7. مراجع

1. مقدمه

رشد سریع برنامههای کاربردی هوش مصنوعی برای کاربر نهایی، مانند تشخیص تصویر بلادرنگ و هوش مصنوعی مولد، منجر به تقاضاهای بالای داده و پردازش شده است که اغلب از قابلیتهای دستگاه فراتر میرود. هوش مصنوعی لبه با تخلیه محاسبات به لبه شبکه، جایی که پردازش هوش مصنوعی با شتاب سختافزاری میتواند انجام شود، به این چالشها میپردازد. این رویکرد جزئی جداییناپذیر از هوش مصنوعی و RAN است که مطابق با اتحادیه AI-RAN، جزء کلیدی شبکههای آینده 6G محسوب میشود. در 6G، یکپارچهسازی هوش مصنوعی در سرتاسر دستگاههای لبه-RAN و لبه افراطی، توزیع کارآمد داده و تکنیکهای هوش مصنوعی توزیعشده را پشتیبانی کرده، حریم خصوصی را افزایش داده و تاخیر را برای برنامههایی مانند فراجهان و جراحی از راه دور کاهش میدهد.

علیرغم این مزایا، هوش مصنوعی لبه با چالشهایی روبرو است. محدودیت در دسترسی منابع در لبه میتواند در هنگام تخلیههای همزمان، عملکرد را مختل کند. علاوه بر این، فرض معماری سامانه همگن در ادبیات موجود غیرواقعی است، زیرا دستگاههای لبه از نظر سرعت پردازنده و معماریها (مانند 1.5 گیگاهرتز در مقابل 3.5 گیگاهرتز، یا X86 در مقابل ARM) به طور گستردهای متفاوت هستند که این بر پردازش وظیفه و بهرهبرداری از منابع تأثیر میگذارد.

2. نقشه راه پژوهشی

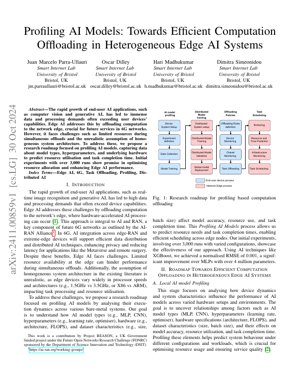

نقشه راه پژوهشی ما بر پروفایلگیری مدلهای هوش مصنوعی برای بهینهسازی تخلیه محاسبات در سامانههای ناهمگون هوش مصنوعی لبه متمرکز است. این فرآیند شامل راهاندازی سامانه، پروفایلگیری مدل هوش مصنوعی، آموزش مدل توزیعشده، سیاستهای تخلیه و زمانبندی وظایف میشود.

2.1 پروفایلگیری محلی مدل هوش مصنوعی

این مرحله تحلیل میکند که چگونه پویایی دستگاه و ویژگیهای سامانه بر عملکرد مدل هوش مصنوعی در پیکربندیهای سختافزاری متنوع تأثیر میگذارد. هدف، کشف روابط میان عواملی مانند انواع مدل هوش مصنوعی (MLP, CNN)، ابرپارامترها (نرخ یادگیری، بهینهساز)، مشخصات سختافزاری (معماری، FLOPS) و ویژگیهای مجموعه داده (اندازه، اندازه دسته) و اثرات آنها بر دقت مدل، بهرهبرداری از منابع و زمان تکمیل وظیفه است.

2.2 پیشبینی منابع و زمان

با استفاده از دادههای پروفایلگیری، نیازهای منابع و زمانهای تکمیل وظیفه را پیشبینی میکنیم تا زمانبندی کارآمد در گرههای لبه میسر شود. از تکنیکهایی مانند XGBoost برای دستیابی به دقت پیشبینی بالا استفاده میشود.

2.3 تخلیه و زمانبندی وظایف

بر اساس پیشبینیها، وظایف تخلیه و زمانبندی میشوند تا تخصیص منابع بهینه شده و عملکرد هوش مصنوعی لبه در محیطهای ناهمگون بهبود یابد.

3. جزئیات فنی

3.1 فرمولبندیهای ریاضی

فرمولهای کلیدی شامل RMSE نرمالشده برای دقت پیشبینی است: $NRMSE = \frac{\sqrt{\frac{1}{n} \sum_{i=1}^{n} (y_i - \hat{y}_i)^2}}{y_{\max} - y_{\min}}$، که در آن $y_i$ مقدار واقعی، $\hat{y}_i$ مقدار پیشبینی شده و $y_{\max} - y_{\min}$ دامنه مقادیر واقعی است. بهرهبرداری از منابع به صورت $R = f(M, H, D)$ مدلسازی شده است، که در آن $M$ نوع مدل، $H$ مشخصات سختافزاری و $D$ ویژگیهای مجموعه داده است.

3.2 پیادهسازی کد

شبهکد برای فرآیند پروفایلگیری:

def ai_model_profiling(model_type, hyperparams, hardware_specs, dataset):

# Initialize system setup

system = SystemSetup(hardware_specs)

# Collect profiling data

data = DataCollection(model_type, hyperparams, dataset)

# Train prediction model using XGBoost

predictor = XGBoostTrainer(data)

# Predict resource utilization and time

predictions = predictor.predict(system)

return predictions

4. نتایج تجربی

آزمایشهای اولیه شامل بیش از 3000 اجرا با پیکربندیهای متنوع بود. با استفاده از XGBoost برای پیشبینی، به RMSE نرمالشده 0.001 دست یافتیم که بهبود قابل توجهی نسبت به MLPهای با بیش از 4 میلیون پارامتر محسوب میشود. این موضوع، اثربخشی رویکرد پروفایلگیری ما را در بهینهسازی تخصیص منابع و بهبود عملکرد هوش مصنوعی لبه نشان میدهد.

شکل 1 نقشه راه پژوهشی را نشان میدهد که جریان از راهاندازی سامانه دستگاه تا زمانبندی وظایف را به تصویر کشیده و یکپارچهسازی دادههای پروفایلگیری در سیاستهای تخلیه را برجسته میسازد.

5. تحلیل اصیل

این پژوهش با پرداختن به ناهمگونی دستگاههای لبه از طریق پروفایلگیری سیستماتیک مدل هوش مصنوعی، پیشرفتی حیاتی در هوش مصنوعی لبه ارائه میدهد. این رویکرد با دیدگاه اتحادیه AI-RAN برای شبکههای 6G همسو است، جایی که تخلیه محاسبات کارآمد برای برنامههای حساس به تاخیر مانند وسایل نقلیه خودران و واقعیت افزوده ضروری است. استفاده از XGBoost برای پیشبینی منابع که به RMSE نرمالشده 0.001 دست یافته، از روشهای سنتی مانند MLPها بهتر عمل میکند، مشابه بهبودهای مشاهده شده در CycleGAN برای وظایف ترجمه تصویر (Zhu و همکاران، 2017). این کارایی برای سامانههای بلادرنگ که محدودیت منابع در آنها از اهمیت بالایی برخوردار است، همانطور که در مطالعات کنسرسیوم رایانش لبه IEEE ذکر شده، حیاتی است.

روششناسی پروفایلگیری، وابستگیهای بین ابرپارامترهای مدل، مشخصات سختافزاری و معیارهای عملکرد را ثبت کرده، امکان زمانبندی پیشبینانه را فراهم میکند. این امر مشابه تکنیکهای یادگیری تقویتی در سامانههای توزیعشده است، مانند مواردی که توسط گوگل ریسرچ برای بهینهسازی مرکز داده کاوش شدهاند. با این حال، تمرکز بر محیطهای لبه bare-metal به دلیل تغییرپذیری سختافزاری، لایهای از پیچیدگی اضافه میکند که اغلب در سامانههای هوش مصنوعی همگن مبتنی بر ابر نادیده گرفته میشود. یکپارچهسازی با زیرساخت 6G، حریم خصوصی بهبودیافته و تاخیر کاهش یافته را نوید داده و از برنامههای نوظهور مانند فراجهان پشتیبانی میکند. کار آینده میتواند یکپارچهسازی یادگیری فدرال را، همانطور که توسط Konečný و همکاران (2016) پیشنهاد شده، برای بهبود بیشتر حریم خصوصی دادهها در عین حفظ دقت پروفایلگیری کاوش کند.

در کل، این پژوهش با ارائه یک راهحل مقیاسپذیر برای سامانههای ناهمگون، شکافی در ادبیات هوش مصنوعی لبه پل میزند که تأثیرات بالقوهای بر استانداردسازی 6G و چارچوبهای رایانش لبه دارد. نتایج تجربی از 3000 اجرا، رویکرد را اعتبارسنجی کرده و پایهای برای تخلیه تطبیقی در محیطهای پویا ایجاد میکند.

6. کاربردها و جهتهای آینده

کاربردهای آینده شامل تجربیات پیشرفته فراجهان، پایش سلامت از راه دور و دستههای پهپاد خودران میشود. جهتها شامل یکپارچهسازی یادگیری فدرال برای حریم خصوصی، بهرهگیری از برشبندی شبکه 6G برای تخصیص منابع پویا و گسترش پروفایلگیری برای دربرگیری معماریهای رایانش نورومورفیک است.

7. مراجع

- AI-RAN Alliance. (2023). AI-RAN Working Groups. Retrieved from https://ai-ran.org/working-groups/

- Zhu, J. Y., Park, T., Isola, P., & Efros, A. A. (2017). Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Networks. In IEEE International Conference on Computer Vision (ICCV).

- Konečný, J., McMahan, H. B., Yu, F. X., Richtárik, P., Suresh, A. T., & Bacon, D. (2016). Federated Learning: Strategies for Improving Communication Efficiency. arXiv preprint arXiv:1610.05492.

- IEEE Edge Computing Consortium. (2022). Edge Computing Standards and Practices. Retrieved from https://www.ieee.org