目錄

1. 引言

終端用戶AI應用(例如實時圖像識別同生成式AI)嘅快速增長,導致數據同處理需求急升,往往超出設備能力。邊緣AI通過將計算卸載到網絡邊緣嚟應對呢啲挑戰,喺邊緣可以進行硬件加速嘅AI處理。呢種方法係AI同無線接入網(RAN)不可或缺嘅一部分,根據AI-RAN聯盟嘅規劃,佢係未來6G網絡嘅關鍵組成部分。喺6G中,跨邊緣-RAN同極端邊緣設備嘅AI集成將支持高效數據分發同分布式AI技術,為元宇宙同遠程手術等應用提升私隱保護同降低延遲。

儘管有呢啲好處,邊緣AI仍然面臨挑戰。邊緣資源有限可能會喺同時進行多個卸載時影響性能。此外,現有文獻中假設系統架構同質係唔現實嘅,因為邊緣設備喺處理器速度同架構(例如1.5GHz對3.5GHz,或者X86對ARM)上差異好大,會影響任務處理同資源利用率。

2. 研究路線圖

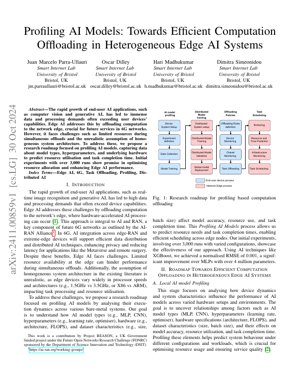

我哋嘅研究路線圖重點在於剖析AI模型,以優化異構邊緣AI系統中嘅計算卸載。過程涉及系統設置、AI模型剖析、分布式模型訓練、卸載策略同任務調度。

2.1 本地AI模型剖析

呢個階段分析設備動態同系統特性點樣影響唔同硬件設置下嘅AI模型性能。目標係揭示各種因素之間嘅關係,例如AI模型類型(MLP、CNN)、超參數(學習率、優化器)、硬件規格(架構、FLOPS)同數據集特徵(大小、批次大小),以及佢哋對模型準確度、資源利用率同任務完成時間嘅影響。

2.2 資源同時間預測

使用剖析數據,我哋預測資源需求同任務完成時間,以實現跨邊緣節點嘅高效調度。採用XGBoost等技術以實現高預測準確度。

2.3 任務卸載同調度

基於預測結果,任務被卸載同調度,以優化資源分配並提升異構環境中嘅邊緣AI性能。

3. 技術細節

3.1 數學公式

關鍵公式包括用於預測準確度嘅歸一化均方根誤差:$NRMSE = \frac{\sqrt{\frac{1}{n} \sum_{i=1}^{n} (y_i - \hat{y}_i)^2}}{y_{\max} - y_{\min}}$,其中$y_i$係實際值,$\hat{y}_i$係預測值,$y_{\max} - y_{\min}$係實際值嘅範圍。資源利用率建模為$R = f(M, H, D)$,其中$M$係模型類型,$H$係硬件規格,$D$係數據集特徵。

3.2 代碼實現

剖析過程嘅偽代碼:

def ai_model_profiling(model_type, hyperparams, hardware_specs, dataset):

# 初始化系統設置

system = SystemSetup(hardware_specs)

# 收集剖析數據

data = DataCollection(model_type, hyperparams, dataset)

# 使用XGBoost訓練預測模型

predictor = XGBoostTrainer(data)

# 預測資源利用率同時間

predictions = predictor.predict(system)

return predictions

4. 實驗結果

初步實驗進行咗超過3,000次運行,涵蓋多種配置。使用XGBoost進行預測,我哋達到咗0.001嘅歸一化均方根誤差,相比擁有超過400萬個參數嘅MLP有顯著提升。呢個結果證明咗我哋嘅剖析方法喺優化資源分配同提升邊緣AI性能方面嘅有效性。

圖1展示咗研究路線圖,顯示咗從設備系統設置到任務調度嘅流程,並突出咗剖析數據點樣整合到卸載策略中。

5. 原創分析

呢項研究通過系統性嘅AI模型剖析,解決邊緣設備嘅異構性問題,為邊緣AI帶來關鍵性進展。呢個方法符合AI-RAN聯盟對6G網絡嘅願景,其中高效嘅計算卸載對於自動駕駛汽車同增強現實等對延遲敏感嘅應用至關重要。使用XGBoost進行資源預測,達到0.001嘅歸一化均方根誤差,表現優於MLP等傳統方法,類似於CycleGAN喺圖像翻譯任務中嘅改進(Zhu et al., 2017)。呢種效率對於資源限制至關重要嘅實時系統係關鍵,正如IEEE邊緣計算聯盟研究中指出嘅。

剖析方法捕捉咗模型超參數、硬件規格同性能指標之間嘅依賴關係,從而實現預測性調度。呢個類似於分布式系統中嘅強化學習技術,例如Google Research為數據中心優化所探索嘅方法。然而,由於硬件可變性,專注於裸機邊緣環境增加咗一層複雜性,呢點喺同質嘅基於雲端嘅AI系統中經常被忽略。與6G基礎設施嘅集成有望增強私隱同降低延遲,支持元宇宙等新興應用。未來工作可以探索聯邦學習集成,正如Konečný等人(2016)所提出嘅,以喺保持剖析準確度嘅同時進一步改善數據私隱。

總體而言,呢項研究通過為異構系統提供可擴展嘅解決方案,彌補咗邊緣AI文獻中嘅一個空白,並可能對6G標準化同邊緣計算框架產生影響。來自3,000次運行嘅實證結果驗證咗呢個方法,為動態環境中嘅自適應卸載奠定咗基礎。

6. 未來應用同方向

未來應用包括增強嘅元宇宙體驗、遠程醫療監護同自主無人機群。方向涉及集成聯邦學習以保護私隱、利用6G網絡切片進行動態資源分配,以及擴展剖析以涵蓋神經形態計算架構。

7. 參考文獻

- AI-RAN Alliance. (2023). AI-RAN Working Groups. Retrieved from https://ai-ran.org/working-groups/

- Zhu, J. Y., Park, T., Isola, P., & Efros, A. A. (2017). Unpaired Image-to-Image Translation using Cycle-Consistent Adversarial Networks. In IEEE International Conference on Computer Vision (ICCV).

- Konečný, J., McMahan, H. B., Yu, F. X., Richtárik, P., Suresh, A. T., & Bacon, D. (2016). Federated Learning: Strategies for Improving Communication Efficiency. arXiv preprint arXiv:1610.05492.

- IEEE Edge Computing Consortium. (2022). Edge Computing Standards and Practices. Retrieved from https://www.ieee.org